Masalah ini telah dibahas beberapa kali di StackOverflow:

- Bagaimana cara meningkatkan performa untuk tugas Spark yang lambat menggunakan koneksi DataFrame dan JDBC?

- spark jdbc df limit... apa fungsinya?

- Bagaimana cara menggunakan sumber JDBC untuk menulis dan membaca data di (Py)Spark?

dan di sumber eksternal:

jadi hanya untuk mengulangi - secara default DataFrameReader.jdbc tidak mendistribusikan data atau membaca. Ini menggunakan utas tunggal, pelaksana tunggal.

Untuk mendistribusikan bacaan:

-

gunakan rentang dengan

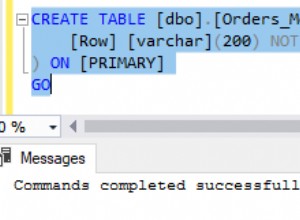

lowerBound/upperBound:Properties properties; Lower Dataset<Row> set = sc .read() .option("partitionColumn", "foo") .option("numPartitions", "3") .option("lowerBound", 0) .option("upperBound", 30) .option("url", url) .option("dbtable", this.tableName) .option("driver","com.mysql.jdbc.Driver") .format("jdbc") .load(); -

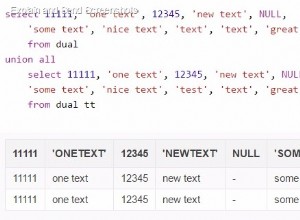

predicatesProperties properties; Dataset<Row> set = sc .read() .jdbc( url, this.tableName, {"foo < 10", "foo BETWWEN 10 and 20", "foo > 20"}, properties )